財經中心/廖珪如報導

群聯(8299)電子於全球AI技術指標性盛會 NVIDIA GTC 展會上,正式發表其革命性的「aiDAPTIV 多層級記憶體架構技術(multi-tier memory architecture)」。此技術旨在協助由 NVIDIA 平台驅動的本地邊緣 AI 系統,在不擴增現有 GPU 硬體的前提下,順利支援更大型的 AI 模型與長上下文推論工作。

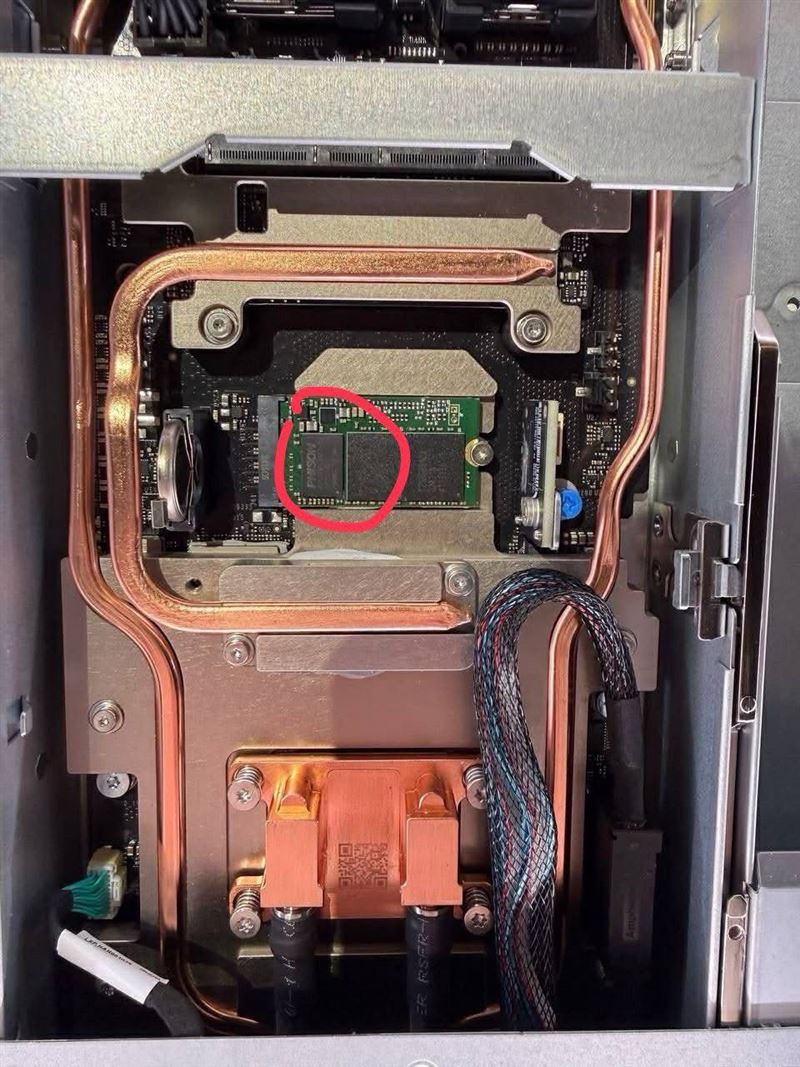

它切進的不是傳統儲存,而是 AI 系統裡最卡、最貴、也最容易限制模型規模的那一層:有效記憶體容量。群聯這次的重點,是把 Pascari 企業級 SSD 拉進 GPU memory、系統 RAM、Flash 之間,變成 AI runtime 可以調度的記憶體層級,目標是在不增加 GPU 硬體的前提下,支撐更大的模型、更長的上下文,以及更吃記憶體的本地推論與微調。

官方展示場景也直接點名 long-context inference、agentic AI workflow、KV cache reuse,以及 memory-intensive fine-tuning,搭配的平台包括 NVIDIA GB10 Grace Blackwell、GeForce RTX 50 系列與 RTX PRO 6000 Blackwell Max-Q。這代表群聯不是在賣單純容量,而是在碰 AI 記憶體分層管理這件事。

素有半導體先知,前明星經理人沈萬鈞在粉專「萬鈞法人視野」分析,群聯這件事厲害的地方,不在於它「取代 HBM」或「取代 DRAM」,而在於它把原本不能進工作集的 NAND,變成可以參與 AI 記憶體階層的一部分。AI 推論尤其是長文推論,本質上很吃 KV cache、context retention 與 paging 行為;當工作集超過 VRAM 與主記憶體,系統通常不是效能掉得很難看,就是模型根本跑不起來。群聯現在做的,是把高耐久企業級 Flash 當成 AI-aware memory tier,去延伸 effective memory,而不是用 cheapest storage 的思維在賣 SSD。這種做法對邊緣端、本地端、企業私有資料推論特別有意義,因為這些場景不見得願意為了更大模型直接升級更多 GPU,但又有資料不能上雲、要在本地做推論與微調的需求。

他指出,群聯其實不是今天才開始講這條路線。它在今年 1 月 CES 就已經把 aiDAPTIV+ 往 PC 平台推進,當時官方說法已經很明確:利用 NAND 當成記憶體,去擴大 AI 處理能力,降低 DRAM 需求,讓較大模型能在筆電、桌機、mini-PC 這些平價平台上跑起來;它甚至宣稱在自家測試中,120B 參數的 MoE 推論可以從傳統做法需要 96GB DRAM,降到 32GB DRAM 處理,並且透過把放不進 KV cache 的 tokens 保存下來,讓未來 prompt 不需要重算,推理反應時間可顯著提升。這次 GTC 的多層級架構,等於是把原本 aiDAPTIV+ 在 PC/iGPU 的概念,再往 NVIDIA 邊緣 AI 與本地 AI 系統延伸,產品路線是連續的,不是臨時拼裝的行銷敘事。

從專業角度看,沈萬鈞說,自己會把它定義成「把 NAND 從容量元件,往 AI 記憶體基礎設施元件升級」。這個定位一旦成立,群聯的估值框架就會慢慢變。過去市場看群聯,多半還是控制器、模組、消費性儲存、企業級 SSD 這幾條線;但 aiDAPTIV 如果能真正跑進 OEM、工作站、邊緣伺服器、企業私有化 AI appliance,群聯賣的就不只是 controller ASP,也不只是 SSD 容量,而是帶有軟硬整合能力的 platform value。這種 platform value 的毛利結構、客戶黏著度、專案生命週期,都比單純賣 NAND controller 好。因為客戶一旦把模型部署、記憶體調度、長上下文推論流程,綁在你這套 runtime 與硬體組合上,替換成本會比一般 SSD 高很多。這也是為什麼我認為它對群聯的中長期意義,大於短線題材。

商機面也不能只看一個方向。第一個商機是本地端 AI 與企業私有化部署。很多企業真正有價值的資料在內網,法遵、資安、延遲、成本都不見得適合全上公有雲,這時候「用既有 GPU 加上更聰明的記憶體階層管理,把模型做大、把上下文拉長」就很有吸引力。第二個商機是邊緣 AI 工作站與小型伺服器。不是每個客戶都要買大型 HGX,很多實際落地案子是在工廠、醫療、零售、安控、設計研發現場,需求是 local inference,不是超大規模訓練。第三個商機是 agentic AI。因為 agent workflow 本來就比單次問答更依賴上下文保存、歷史狀態延續與 KV cache 重用,這剛好是 flash tier 最有機會參與的地方。群聯這次在 GTC 特別把 agentic AI workflow 與 KV cache reuse 拿出來講,這不是裝飾詞,這是在對準下一階段 workload。

這項技術也有它的邊界。第一,它不是免費午餐。Flash 再怎麼優化,也不會變成 HBM 的延遲與頻寬,所以這比較像是把原本跑不動、裝不下、或必須重算的 workload,變成可跑、可留、可延伸,而不是讓所有推論都直接等速升級。第二,它適合的是記憶體受限、上下文很長、可以接受分層調度的場景,不是所有 low-latency 極致即時任務都能同樣受惠。第三,這條路要真正放大,不能只有技術發表,還要看實際 benchmark、客戶導入、ODM/OEM 綁定、以及軟體堆疊是否能被開發者接受。

這是群聯開始從「NAND 控制器公司」往「AI 記憶體架構公司」靠的一個訊號。這家公司未來評價方式將會比較獨特,它短線未必立刻反映成爆量獲利,但中線很值得追蹤。因為 AI 發展到今天,瓶頸早就不只在算力,而是在算力後面的記憶體階層、資料移動、上下文長度、成本結構與本地部署能力。誰能把這幾件事整合起來,誰就有機會從零組件供應商,往基礎設施平台供應商升級。群聯這次的 aiDAPTIV 多層級記憶體架構,真正有價值的地方就在這裡。它不是要跟 HBM 正面對撞,而是在 HBM、DRAM 越來越貴、越來越缺的時代,替市場補上一層過去不存在、但未來會越來越重要的 AI 記憶體層。這條路如果走通,群聯後面看到的,不只是 SSD 商機,而是 AI 基礎設施重估。

三立新聞網提醒您:

內容僅供參考,投資人於決策時應審慎評估風險,並就投資結果自行負責。

投資一定有風險,基金投資有賺有賠,申購前應詳閱公開說明書。

更多三立新聞網報導

. 快檢查!不是炎黃子孫? 這四個姓代表你可能戰神後代

. 盤前/日商村田漲價 被動元件18檔起飛

. 熱門股/黃仁勳GTC總點將 台廠30檔

. 熱門股/黃仁勳推的龍蝦 NemoClaw 18檔